Publicada la Guía Práctica para la Evaluación de Impacto Algorítmico en Derechos Fundamentales

- Pere Simón Castellano

- hace 2 días

- 3 Min. de lectura

Una herramienta operativa para la gobernanza de la IA

La inteligencia artificial ya no es una promesa futura: es una tecnología que está tomando decisiones hoy. Y precisamente por eso, el reto ya no es solo innovar, sino hacerlo de forma responsable, conforme a derecho y con garantías efectivas para las personas.

En este contexto, desde OdiseIA presentamos la nueva:

Guía práctica para la elaboración de una evaluación de impacto algorítmico en los derechos fundamentales (EIDF o FRIA)

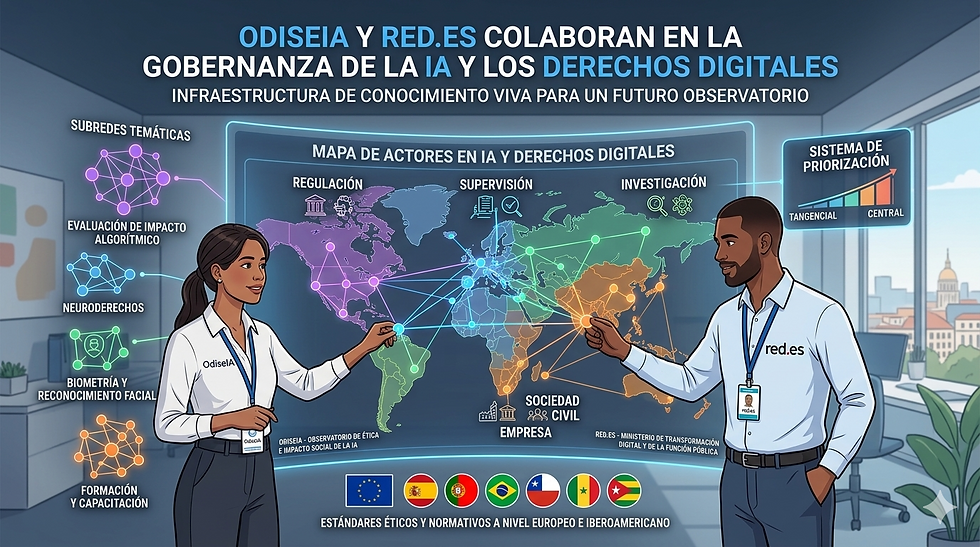

Desarrollada en el marco del proyecto Red.es – Carta de Derechos Digitales (Ámbito 6), esta guía ofrece algo que hasta ahora escaseaba: una metodología clara, aplicable y orientada a la toma de decisiones reales en el uso de sistemas de inteligencia artificial.

¿Por qué es relevante esta guía?

Porque responde a una necesidad crítica:

El Reglamento de IA de la Unión Europea (RIA) no solo regula sistemas.

Exige gobernar riesgos.

En particular, el artículo 27 introduce la obligación de realizar evaluaciones de impacto en derechos fundamentales para determinados sistemas de alto riesgo.

¿Cómo se hace esto en la práctica?

Esta guía responde precisamente a esa pregunta. A diferencia de aproximaciones puramente académicas o formales, esta guía parte de una idea central:

Una evaluación de impacto no es un documento. Exige gobernanza liderada por personas.

Tal y como se recoge en el documento, una evaluación de impacto es un proceso previo, estructurado y orientado a identificar:

A quién afecta un sistema de IA

Qué riesgos genera sobre derechos fundamentales

Con qué probabilidad y gravedad

Qué medidas permiten reducir esos riesgos

Y, sobre todo, permite responder a la pregunta clave:

¿Se puede desplegar este sistema? (go / condicionado / no-go)

Un enfoque realmente útil para organizaciones

La guía introduce una metodología operativa basada en cinco pilares:

Enfoque socio-técnico del riesgo (no solo el modelo, sino el contexto)

Evaluación mediante matrices de probabilidad × gravedad

Diferenciación entre riesgo inherente y riesgo residual

Participación de actores afectados como elemento clave

Integración con cumplimiento (RGPD, EIPD, gobernanza interna)

El resultado es un modelo que permite a empresas y administraciones:

✔ Tomar decisiones informadas

✔ Documentar el cumplimiento de forma defendible

✔ Reducir riesgos regulatorios y reputacionales

✔ Incorporar derechos fundamentales desde el diseño

Más allá de privacidad y sesgo

Uno de los aportes más relevantes es ampliar el foco habitual.

La práctica demuestra que muchas organizaciones reducen el análisis a:

protección de datos

no discriminación

Pero la guía insiste en que el impacto real va mucho más allá:

acceso a oportunidades

tutela judicial efectiva

transparencia

libertad informativa

derecho de defensa

Este cambio de enfoque es clave para una gobernanza de la IA verdaderamente alineada con los derechos fundamentales.

Medir, mitigar y decidir

La guía incorpora herramientas prácticas listas para usar:

✔ Matriz de riesgo (P × G)

✔ Fórmula de riesgo residual

✔ Checklist estructurado

✔ Módulo específico de sesgo algorítmico

✔ Métricas de equidad (DIR, TPR, FPR, etc.)

✔ Plantillas completas (acta, ficha de sistema, registro de riesgos)

Todo ello pensado para facilitar su uso en entornos reales, sin necesidad de alta especialización técnica.

Una guía para empresas y sector público

La guía está diseñada para:

Administraciones públicas

Empresas que despliegan IA

Equipos de compliance, legal y riesgos

Responsables de innovación y tecnología

Y responde a un objetivo claro:

Convertir la gobernanza de la IA en algo ejecutable.

Puedes consultar la guía completa aquí:

La inteligencia artificial no es neutral. Pero sí puede ser gobernada.

Y esa gobernanza empieza por herramientas como la que ofrecemos desde OdiseIA.

Comentarios